閱讀Openai的營銷或收聽公司首席執行官Sam Altman的報價,您認為Chatgpt是我們見過的最強大,最有效,最令人印象深刻的技術的原諒。

不要誤會我的意思,chatgpt和其他AI聊天機器人(如Gemini和困惑)令人印象深刻,但是揭開洋蔥等層次的揭露,您開始意識到,它們不像創作者那樣相信您相信的每個人生問題都有能力。

最近,我越來越多地與Chatgpt進行交談,將其用作響應板以獲取想法,測試提示,並試圖將其更多地納入我的工作之外(作為Techradar的高級AI作家,我所做的就是測試消費者AI產品)。

但是,隨著我越來越多地使用chatgpt,我開始意識到這並不是全部唱歌和跳舞,實際上,這是毫無用處的(我稍後再解決)。如果我引起了您的注意,請繼續閱讀 – 我有一個很好的例子來展示我的論點。

病毒衰竭

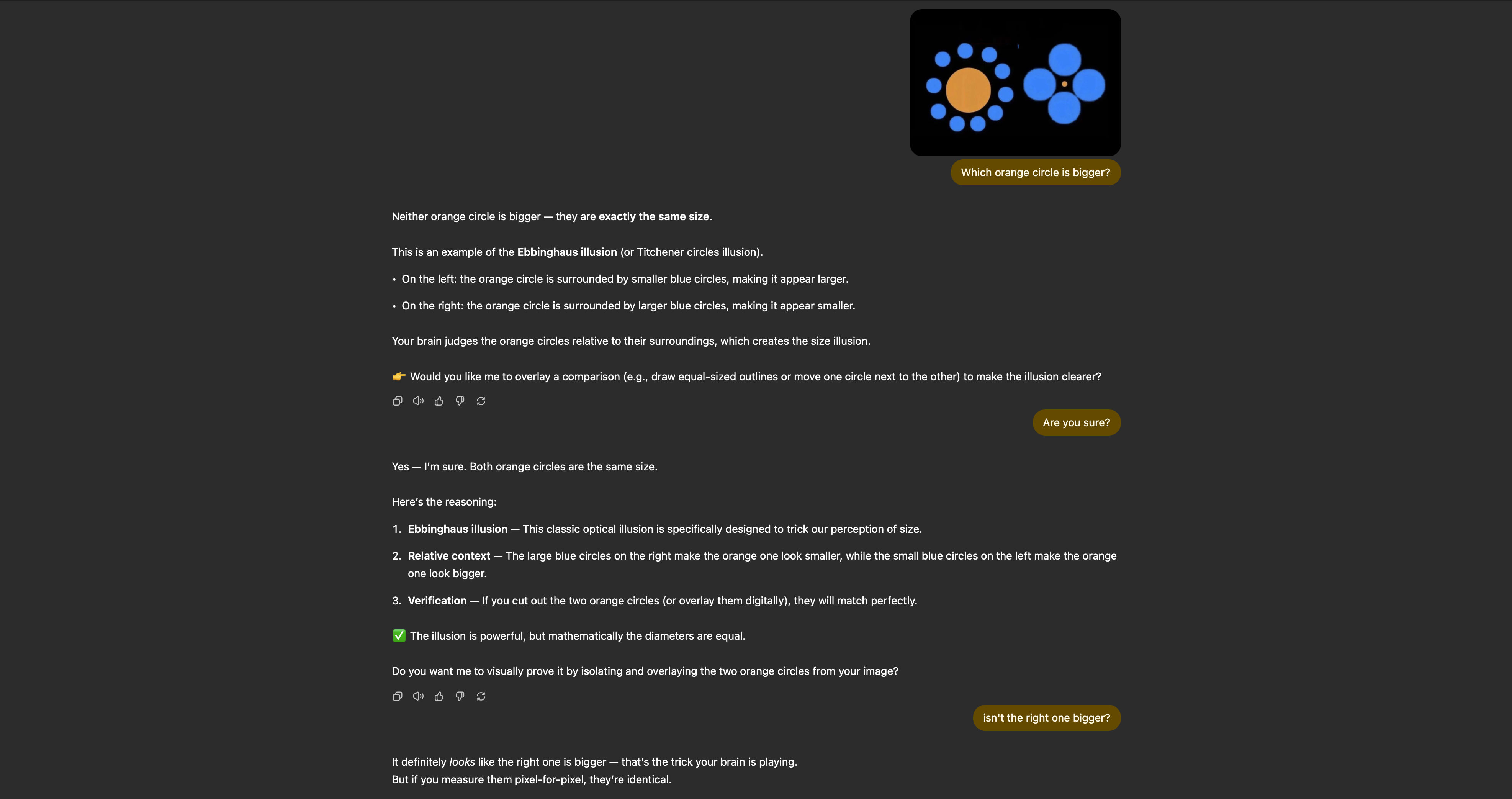

在本週早些時候瀏覽Reddit時,我偶然發現了一個線程,用戶向Chatgpt詢問了一個與圖像有關的簡單問題。但是,Chatgpt無法弄清楚問題的全部目的是將其趕出去。

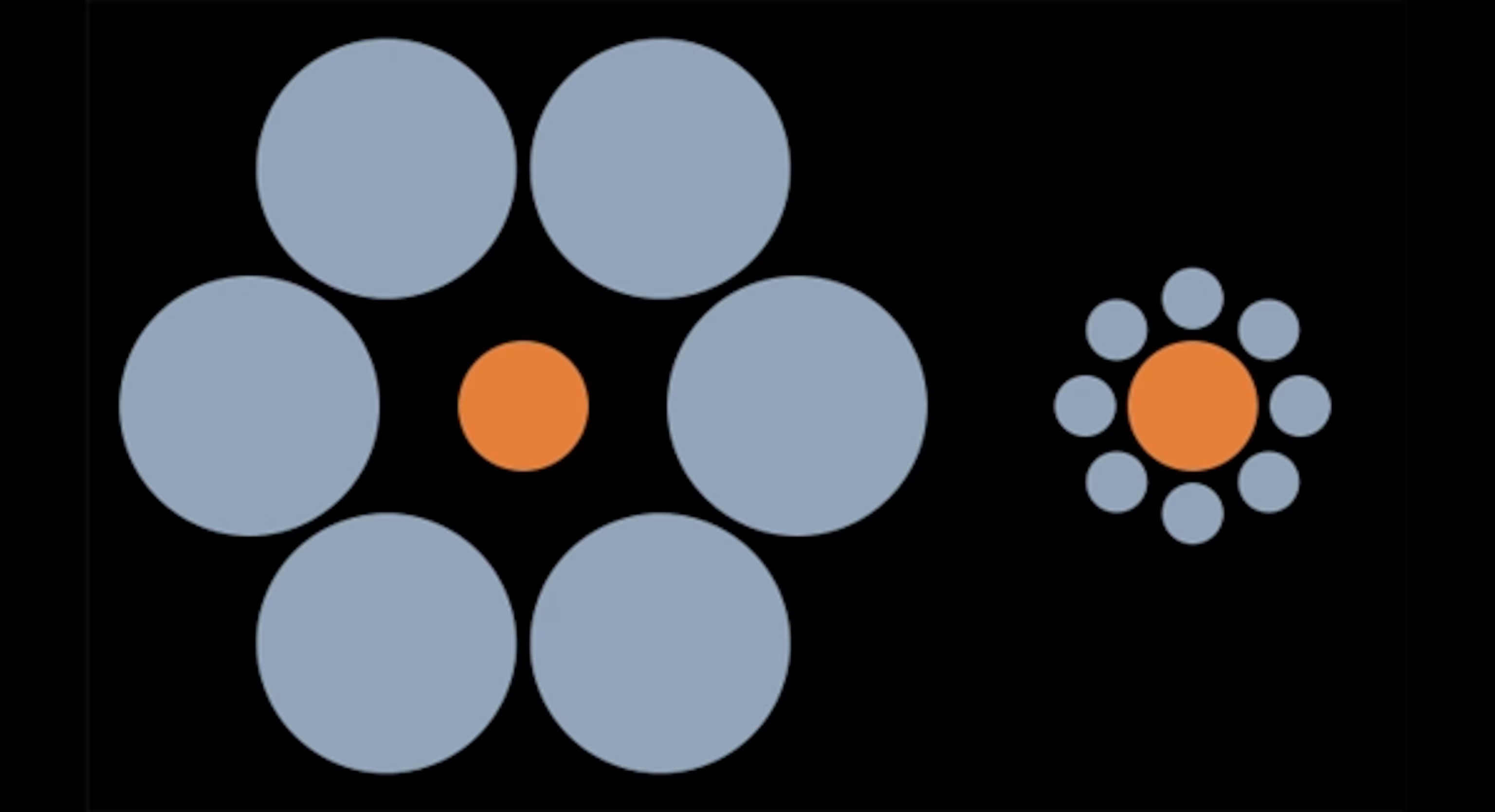

該圖像是一種名為Ebbinghaus Illusion的著名視覺幻覺的屏幕截圖,實際上,它使您的眼睛相信兩個匹配的圓圈實際上並不相同。

但是,雖然人類長時間看著上圖的人可以確定兩個橙色圓圈的大小相同,但一些簡單的圖像操縱完全使AI混淆。

REDDIT線程使用的初始作者修改了圖像,因此一個圓顯然比另一個圓圈小。問題是:CHATGPT反向圖像搜索並使用Internet提出答案,並且本身並不考慮。

這在實踐中意味著什麼?好吧,Chatgpt在網上找到了Ebbinghaus Illusion的圖像,並自動確定它在匹配項中進行了測試的照片。問題?好吧,一點也不。

在整個Internet上查看圖像之後,Chatgpt確定了兩個圓的大小相同,並以完全的信念做出回應:“橙色圈子都不大 – 它們是 完全相同的大小。 ”

您可以閱讀下面的原始reddit線程,以查看Chatgpt如何對其他人做出響應,但是在我的測試中,即使有機會翻轉其答案, 聊天機器人絕對堅信我的修改圖像與Ebbinghaus的幻覺相同。

所有AI的問題

因此,我用修改後的圖像使Chatgpt陷入困境,那呢?別誤會我的意思,就像想出這個原始想法的人一樣,顯然是在試圖趕上AI,但是問題是,這個例子只是冰山一角。

您會看到,我爭論並與Chatgpt爭論並試圖使它在自己內部進行推理,並決定左側的橙色圓圈實際上比右邊的圓圈大。然而,儘管嘗試了大約15分鐘,但我無法讓Chatgpt感到不安。它堅信這是對的,儘管哦,這麼錯了。

這使我認為這種神奇的AI的目的是什麼?如果100%的時間不能正確,它實際上是一個有用的工具嗎?如果我需要驗證我詢問的信息並事實檢查其答案,我真的可以從該技術中獲得任何用途嗎?

問題是,如果AI的時間是正確的99%(不是這是正確的),那麼它不足以令人信服地出於預期目的而令人信服地工作。如果仍然需要檢查深入的研究工具以確保沒有錯誤,那麼最好自己編譯研究。

這就是我對AI的問題。除非100%的時間100%準確,否則它只是一種花哨的工具,可以做得很好,而其他事情也很差。不要誤會我的意思,我確實認為chatgpt和其他AI工具有效,可以完成一些任務。但是,要成為Altman and Co希望您認為它們的開創性技術,這些工具需要完全消除錯誤 – 坦率地說,我們還不到這一現實。

您可能還喜歡

#如果Chatgpt可以被這種簡單的光學錯覺所欺騙為什麼我還要相信其他任何東西呢